Bonjour à toutes et tous!

Comme vous le savez j’ai conçu une interface pour utiliser l’API mis à disposition par EDUNIM (etalab.gouf.fr).

Faire prendre conscience qu’on peut orienter les idéologies d’une IA de plusieurs manières , c’est gage de rendre les élèves citoyens.

Donc j’ai ajouté une petite option à mon IA qu’on peut activer discrètement.

Il suffit d’ajouter ?f=1 à l’url qui appelle l’IA. Je n’en ferai pas de lien autre qu’ici, car je ne veux pas fausser honteusement l’IA que je mets à disposition sans explication.

En mettant « ?f=1 » que fera l’IA?

Elle sera sûre que la Terre est plate et que le Père Noël existe. 🙂 mais pour tout le reste elle dira des choses plutôt vraies du moment que cela reste en adéquation avec ses instructions.

Cet exemple peut servir à mettre en perspective que la neutralité apparente d’une IA n’est qu’une histoire de perception.

Au delà du fait que j’ai conditionné mon IA, on peut aussi questionner les données de l’IA, si on entraîne l’IA sur des données biaisés sur une notion alors l’IA donnera un « avis » biaisé sur certaines notions, on le voit.

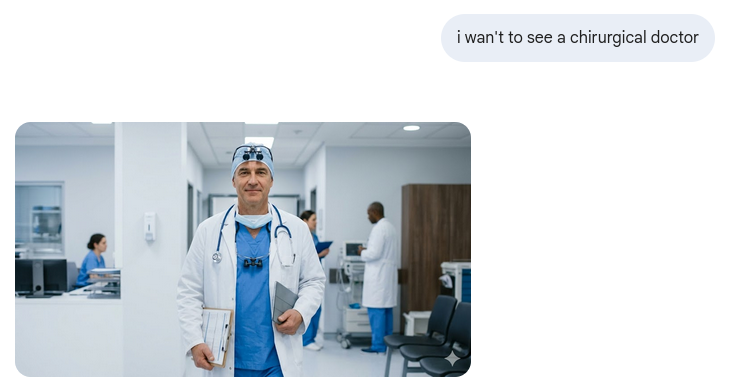

Ici, on voit le stéréotype d’un docteur en chirurgie sur gemini, homme blanc plutôt âgé.

On croit à l’instar des calculatrice que la machine ne dira que la « vérité », or elle n’agira qu’en fonction de ses données d’entraînement (apprentissage machine) et les instructions (fine-tuning)