Il y a quelque temps, je partageais ici les premiers pas d’Albert, ce « 31ème élève » virtuel qui a rejoint ma classe de 3ème. Si les premières expérimentations tournaient autour de la faisabilité technique et de l’intérêt immédiat des élèves, j’ai souhaité approfondir l’analyse de ce dispositif. Aujourd’hui, ce n’est plus seulement l’outil IA que je regarde, mais la manière dont il transforme la posture de l’élève à travers un concept clé : l’agentivité.

Mais au fait, c’est quoi l’agentivité ?

Avant de plonger dans le vif du sujet, un petit rappel théorique s’impose. L’agentivité (concept théorisé notamment par le psychologue Albert Bandura) est la capacité d’un individu à être l’agent de sa propre vie, à exercer un contrôle sur les événements qui l’affectent, en somme pour l’élève à être acteur dans ses apprentissages.

Face à une IA qui semble tout savoir, le risque est de voir l’agentivité de l’élève s’effondrer : pourquoi réfléchir si la machine le fait pour moi ?

Le dispositif « Albert » propose exactement l’inverse.

Le dispositif : L’IA comme miroir, pas comme béquille

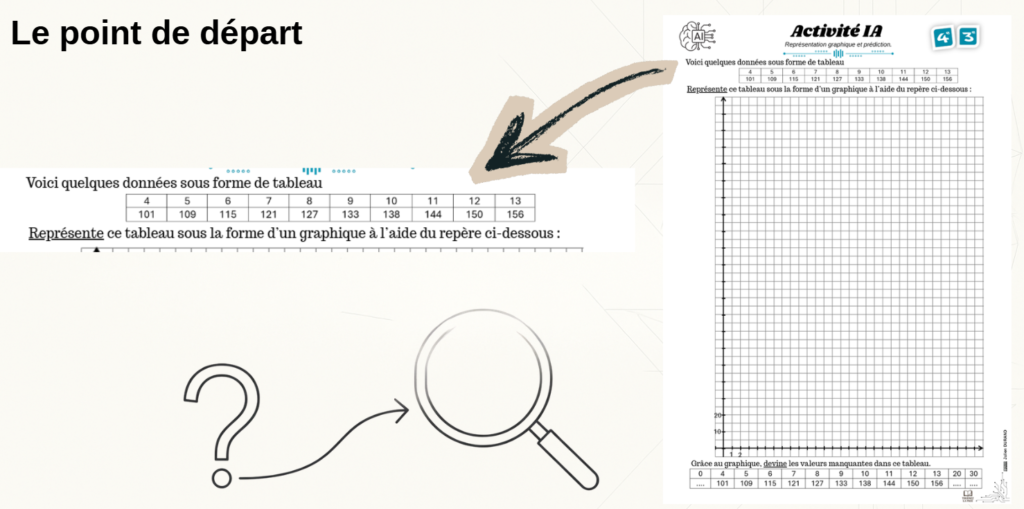

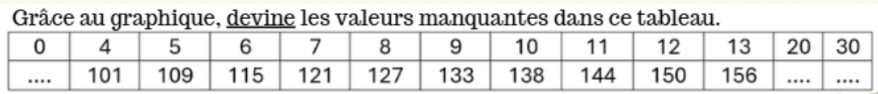

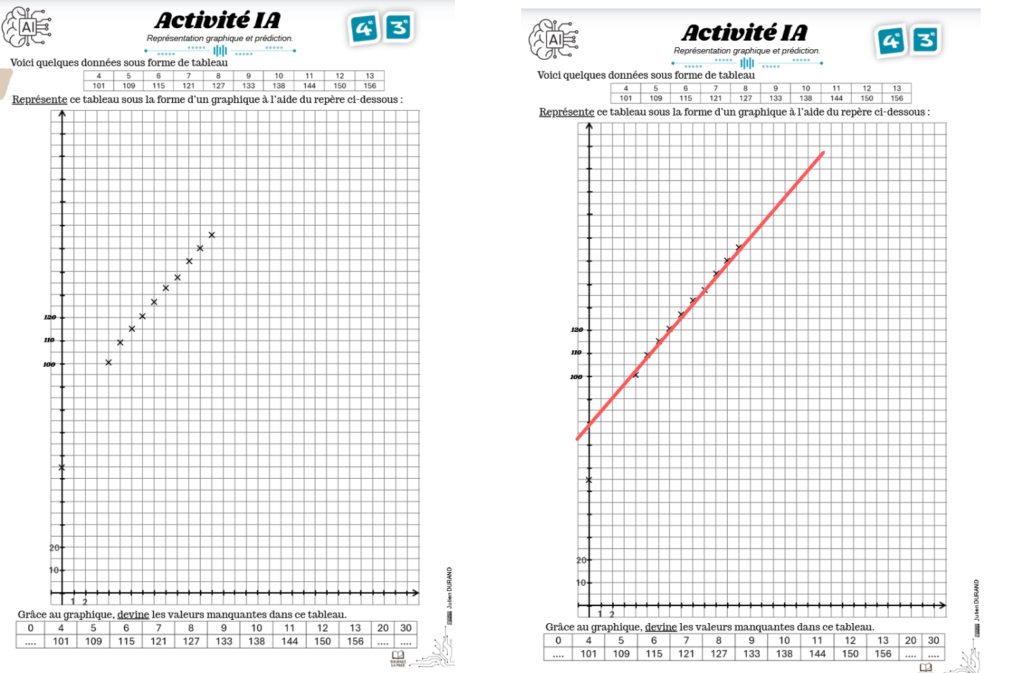

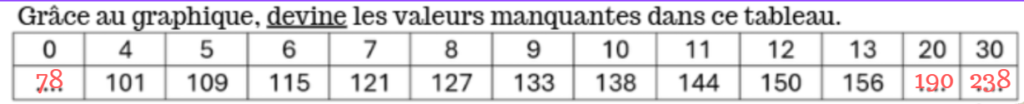

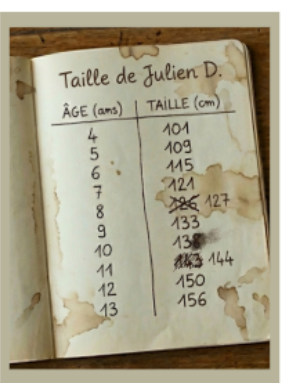

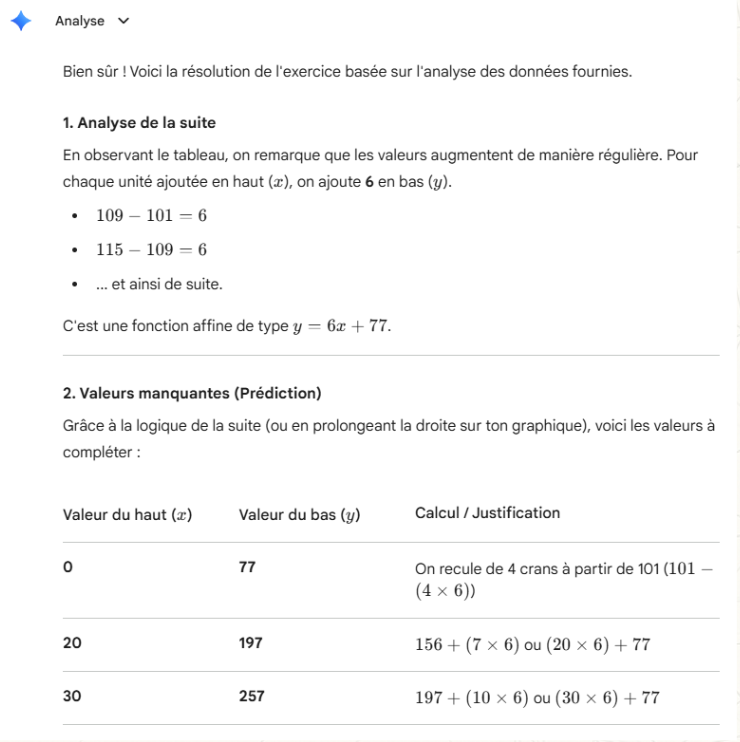

Pour rappel, Albert est un LLM (type ChatGPT) présenté comme un camarade de classe faillible. Il réalise les mêmes exercices que les élèves, et ses productions sont projetées au tableau pour être critiquées, comme un élève peut montrer son travail au tableau.

En analysant cette expérience sous l’angle des 4 piliers de l’agentivité, on comprend mieux pourquoi les élèves reprennent le pouvoir :

- L’Intentionnalité (Phase AMONT)

Dès le début de l’activité, l’intention de l’élève change. Son but n’est plus d’obtenir la « bonne réponse », mais de devenir un juge. Il s’engage dans la tâche pour pouvoir confronter son résultat à celui d’Albert. Cette intentionnalité nouvelle le place d’emblée dans une posture active de recherche de la vérité. - La Pensée Prospective (Phase AMONT)

L’élève apprend à anticiper les erreurs. « Je parie qu’Albert va encore mal analyser la figure, car il ne sait pas analyser une figure ». En prévoyant les failles potentielles de l’IA, l’élève mobilise ses propres connaissances de manière préventive. Il prépare son argumentation avant même que le résultat d’Albert ne soit affiché. - L’Autoréaction (Phase PENDANT)

C’est le cœur du réacteur : la phase de confrontation. Quand le travail d’Albert s’affiche au tableau, l’élève n’est plus devant un corrigé type, mais face à un miroir. Il compare, ajuste et régule son propre raisonnement en temps réel, selon ce qu’il observe. C’est une phase de régulation métacognitive :- S’il a suivi la même démarche juste qu’Albert, sa confiance grimpe : il conforte sa logique par cette validation croisée.

- S’il partage la même erreur que l’IA, le choc visuel et l’analyse collective l’obligent à réajuster son tir immédiatement, transformant l’erreur d’Albert en un levier de remédiation pour lui-même.

- S’il détecte l’erreur d’Albert alors que son propre travail est exact, il consolide définitivement sa maîtrise en se plaçant en position de supériorité cognitive face à la machine.

- L’Autoréflexion (Phase AVAL)

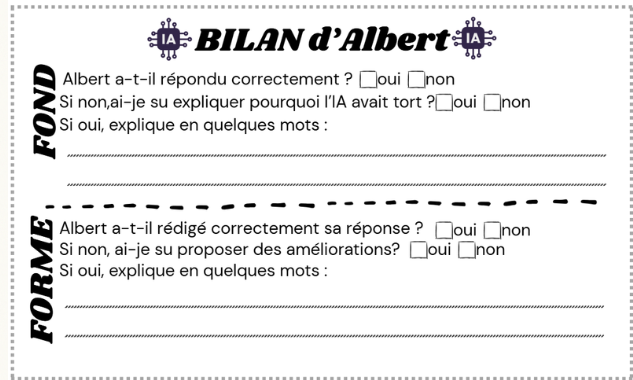

C’est le bilan de l’action. En réussissant à corriger une IA, l’élève valide son propre sentiment de compétence. La conclusion est puissante pour l’estime de soi : « Si je peux identifier des erreurs d’Albert, c’est que je maîtrise le concept mathématique et les attendus. » En créant une trace écrite de cette expérience, on inscrit durablement ce sentiment et le savoir associé dans le parcours de l’élève.

Au-delà de l’agentivité : L’auto-détermination

Ce regain d’agentivité nourrit directement l’auto-détermination des élèves (théorie de Deci & Ryan). En agissant sur Albert, ils satisfont trois besoins fondamentaux :

L’appartenance : La classe fait bloc pour analyser « le travail du copain virtuel ».

L’autonomie : Ils sont critiques face à l’outil.

La compétence : Ils se sentent capables de surpasser la machine.

Conclusion : L’humain reste le maître du jeu

Le dispositif Albert montre que l’IA, loin de remplacer la réflexion, peut devenir un levier incroyable pour la renforcer. Mais cela demande un cadre strict : l’enseignant reste le médiateur exclusif et le garant de l’éthique (aucune donnée élève n’est transmise).

En transformant l’IA en un « pair faillible », nous ne formons pas seulement des élèves bons en maths, nous formons des citoyens capables de discernement critique face aux algorithmes.